在复旦大学计算机科学与技术实践工作站中,人工智能与机器学习已成为核心实践方向。借助Python编程语言与PyTorch深度学习库,结合《动手学深度学习》(D2L)教材体系,学生能够系统掌握机器学习与神经网络的核心原理与网络技术,实现从理论到实践的跨越。

一、机器学习基础与Python实践环境搭建

机器学习作为人工智能的重要分支,旨在通过算法使计算机系统从数据中自动学习规律。复旦大学实践工作站通常以Python作为主要编程语言,因其拥有丰富的科学计算库(如NumPy、Pandas)和机器学习框架。初学者首先需要配置Python环境,安装Jupyter Notebook等交互式工具,为后续的D2L学习与实践奠定基础。

二、PyTorch库入门:动态图与张量计算

PyTorch作为当前主流的深度学习框架之一,以其动态计算图和直观的编程接口受到广泛欢迎。入门阶段重点在于理解其核心数据结构——张量(Tensor),它类似于多维数组,支持GPU加速计算。通过PyTorch提供的自动微分功能,学生能够轻松构建和训练神经网络,而无需手动推导复杂的梯度公式。实践工作站通常会引导学生完成第一个PyTorch程序:定义张量、执行基本运算,并初步接触自动微分机制。

三、D2L学习路径:理论与实践深度融合

《动手学深度学习》(D2L)教材为学习提供了结构化路径。其内容涵盖:

1. 线性神经网络:从最简单的线性回归模型入手,理解损失函数、优化算法(如随机梯度下降)的基本概念。

2. 多层感知机:引入激活函数(如ReLU),讲解从线性模型到非线性模型的扩展原理。

3. 卷积神经网络(CNN):深入解析图像处理中的卷积层、池化层等网络技术,理解参数共享与空间层次结构。

4. 循环神经网络(RNN)与Transformer:处理序列数据的经典与前沿模型,探讨其内部状态传递与注意力机制理论。

在实践环节,学生需跟随D2L的代码示例,在Jupyter Notebook中逐行实现模型构建、数据加载、训练循环及评估全过程,深化对理论的理解。

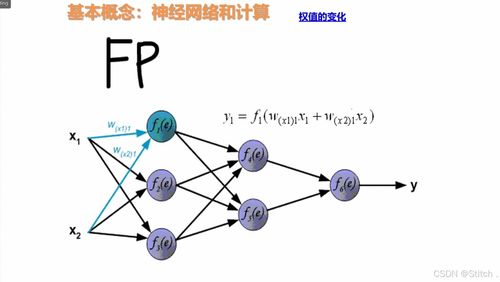

四、神经网络核心原理与网络技术剖析

在掌握工具使用后,需深入理解背后的原理:

- 前向传播与反向传播:神经网络如何通过前向传播计算输出,并利用反向传播算法根据损失函数调整权重。

- 优化算法:除了基础梯度下降,还需了解动量法、Adam等优化器的原理及其对训练收敛的影响。

- 正则化技术:如Dropout、权重衰减等,理解其防止过拟合的理论依据。

- 网络架构设计:学习ResNet、LSTM等经典网络的设计思想,理解深度、宽度、跳跃连接等技术对模型性能的影响。

五、综合项目实践与能力提升

复旦大学实践工作站强调项目驱动学习。典型项目包括:

1. 基于CNN的图像分类任务(如CIFAR-10数据集)。

2. 使用RNN或Transformer的文本情感分析或机器翻译。

3. 生成对抗网络(GAN)的基础实现。

通过完整项目,学生将整合数据预处理、模型设计、训练调试、性能评估全流程,真正掌握将理论知识转化为解决实际问题的网络技术。

从Python基础到PyTorch实战,再到D2L的系统理论学习,这条路径为学生构建了坚实的机器学习与神经网络知识体系。复旦大学计算机科学与技术实践工作站通过这种“工具-理论-实践”三维一体的教学模式,培养学生在人工智能领域不仅知其然,更能知其所以然,具备持续探索前沿网络技术的创新能力。